Les réseaux sociaux utilisés par la majorité de la population ne sont pas des entreprises philanthropiques. Leur modèle économique est uniquement basé sur la publicité. Ce sont des régies publicitaires au sens strict: ils fournissent et gèrent des espaces publicitaires ciblés, à destination des annonceurs. Leur fonctionnement est très simple: le “réseau social”, autrement dit, dans le jargon, “la plateforme”, fournit des services et contenus gratuits vers des milliards d’utilisateurs. Ces services et ces contenus sont accompagnés de publicités, et tous peuvent également être diffusés par d’autres vecteurs, moyennant divers accords de rétribution. En échange, la plateforme s’empare gratuitement des données personnelles et intimes pour mieux cibler individuellement chaque utilisateur.

Les réseaux sociaux utilisés par la majorité de la population ne sont pas des entreprises philanthropiques. Leur modèle économique est uniquement basé sur la publicité. Ce sont des régies publicitaires au sens strict: ils fournissent et gèrent des espaces publicitaires ciblés, à destination des annonceurs. Leur fonctionnement est très simple: le “réseau social”, autrement dit, dans le jargon, “la plateforme”, fournit des services et contenus gratuits vers des milliards d’utilisateurs. Ces services et ces contenus sont accompagnés de publicités, et tous peuvent également être diffusés par d’autres vecteurs, moyennant divers accords de rétribution. En échange, la plateforme s’empare gratuitement des données personnelles et intimes pour mieux cibler individuellement chaque utilisateur.

Vous avez beau penser, lecteurs avertis du Sauvage, que vous n’êtes pas sensibles à la publicité, les chiffres d’affaire des deux principales régies publicitaires montrent qu’il n’en est pas de même pour l’ensemble de la société: Facebook et ses filiales (Instagram, Messenger, Whatsapp), Alphabet et sa filiale Google (Google services, Gmail, Youtube, Blogger, Chrome, Android, etc), ont reçu à elles deux, dans la dernière année, près de 300 milliards de dollars des annonceurs publicitaires. Ces derniers ne dépenseraient pas de telles sommes si la publicité ne fonctionnait pas. Les réseaux sociaux sont devenus les principaux supports du capitalisme, en diffusant des milliards de messages publicitaires destinés à augmenter la consommation.

Chaque plateforme a sa propre stratégie de monétisation, mais les principes sont, au final, identiques. Si vous cliquez pour visiter une publicité, un montant sera incrémenté sur les sommes versées au réseau social par l’annonceur. Si vous réalisez l’achat, un deuxième montant sera éventuellement versé en fonction du modèle de monétisation de la plateforme. Les milliards de dollars de bénéfice des réseaux sociaux sont issus de petites actions de l’utilisateur.

Tout connaitre de votre vie

Pour vendre des espaces publicitaires ciblés, les réseaux sociaux doivent tout connaitre de votre vie. Au moment de votre inscription, vous les avez autorisés à vous espionner et à valoriser les données acquises, sans vous rétribuer. Leurs ordinateurs analysent tout ce que vous offrez: textes, photos, vidéos, contacts, mode d’interaction, mais aussi des données moins visibles, comme celles issues des capteurs de vos smartphones, tablettes, et équipements connectés. Certaines plateformes, comme Youtube (Google/Alphabet), surveillent également le parcours de votre souris ou de vos doigts sur l’écran, afin d’identifier de potentiels intérêts, lorsque vous survolez un lien, une photo ou une vidéo, même sans cliquer. Toute donnée est exploitable et valorisable.

Des études ont montré qu’il est facile de déterminer votre état physiologique ou mental, votre caractère, vos éventuelles faiblesses psychologiques, vos micro-dépressions, vos opinions sur des milliers de sujets. Des analyses prédictives sont faites pour estimer ce que sera votre futur immédiat, ce qui permet d’affiner le placement publicitaire au bon moment.

Comment vous êtes ciblés

A la moindre de vos interactions ou publications, au moindre déplacement (géolocalisation), des ordinateurs stockent vos données brutes: vos contenus, afin de les diffuser sur la plateforme, ainsi que toutes les autres données, invisibles, issues de vos appareils et de vos interactions.

D’autres ordinateurs analysent puis classent ensuite précisément la teneur de ces contenus visibles et invisibles, la nature de vos interactions avec la plateforme, la nature de vos interactions avec d’autres utilisateurs. Enfin, d’autres ordinateurs affinent et stockent dans votre dossier personnel, jour après jour, votre profil sexuel, médical, relationnel, émotionnel, politique, économique, social, professionnel, familial, territorial, financier, gestuel, votre profil de consommateur, de pilote de votre véhicule, etc. C’est votre appartenance à ces profils qui est “vendue” aux annonceurs, qui cherchent toujours des cibles précises. Facebook se vantait en 2019, pouvoir proposer plus de 5000 critères de ciblage aux annonceurs. Devant le tollé général des activistes pro-vie privée et d’une partie de l’opinion, ils n’en montrent plus officiellement que plusieurs centaines. Mais ils n’ont pas supprimé les milliers d’autres critères: on peut accéder à des milliers d’Interêts cachés, par un moteur de recherche interne, qui, de plus, est facilement manipulable pour extraire l’audience de dizaines de milliers d’ intérêts combinés, le tout sur un territoire donné. Le moteur indique même, à la personne près, combien de cibles humaines sont disponibles avec ces critères sur le territoire choisi. De nombreuses startups ont flairé ce filon, et proposent des outils de ciblage dédiés à Facebook, utilisant ce moteur de recherche interne, à destination des annonceurs, ce qui ne peut que ravir la plateforme elle-même.

Il va de soi que le coût écologique et énergétique de toutes ces opérations et des stockages associés, par les plateformes comme par leurs associés, est extrêmement important.

Exploiter vos faiblesses, exploiter votre réseau

C’est ainsi que votre réseau social vous connait mieux que vous, et surtout, connait parfaitement toutes vos faiblesses. Il saura, au cours de la journée, à quel moment exact, dans quelle interaction avec la plateforme ou ses affiliés (par exemple, autres médias comme des journaux, ou tout site disposant de publicité), dans quel flux, dans quel contenu, placer la bonne publicité, et dans quel format (photo, vidéo, lien, Gif animé, etc). Votre cerveau sera plus disponible pour cliquer sur une publicité dans certaines conditions d’humeur précises, par exemple après un échange particulier avec un membre de votre réseau. Cette science de l’interaction est le secret de leurs milliards de dollars de bénéfice.

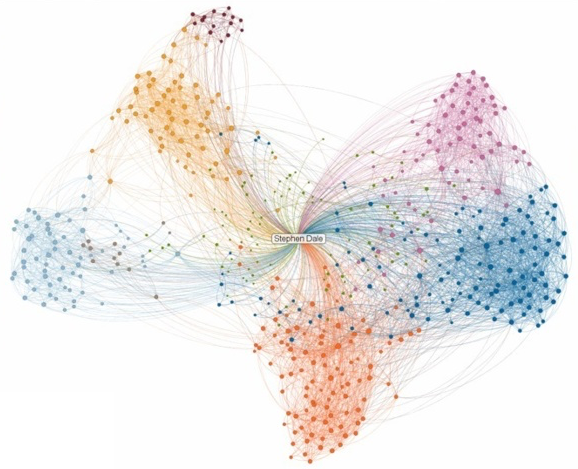

Graphe professionnel d’une personne. L’utilisateur est au centre. Chaque point de couleur est un contact. Les couleurs différencient des catégories particulières. Les distances correspondent au niveau de proximité.

Un exemple: si vous venez de publier, à la famille ou à une amie, la photo de votre nouvelle voiture, ou nouvelle paire de chaussures, ou de votre voyage (passé ou futur), cette pseudo-information sera dirigée vers les membres de vos graphes qui sont susceptibles d’effectuer, par influence, des actes de consommation similaires. Les fonctions cérébrales d’imitation d’autrui sont un des “moteurs commerciaux” des réseaux sociaux comme Instagram ou Facebook, par exemple, en poussant au narcissisme, et à l’émulation entre Narcisses. Cela tombe bien, les réseaux sociaux connaissent parfaitement vos réseaux. Les plateformes déterminent et stockent vos graphes sociaux: votre graphe familial, votre graphe amical, votre graphe professionnel, médical, sexuel, religieux, sportif, etc., ce qui permettra d’affiner les flux d’influence, c’est-à-dire la retransmission automatique de certains de vos contenus uniquement vers certaines personnes de vos graphes.

Pourquoi le réseau social encourage l’interaction: la notion d’engagement

Pour un réseau social, qui dispose d’une vision instantanée de ces utilisateurs et de la visibilité publicitaire associée, et donc des revenus issus des clics, en temps réel, tout est statistique: plus vous interagissez avec la plateforme, plus vous visitez de contenus, plus vous donnez de renseignements à la plateforme, plus vous retransmettez de documents, de liens ou d’avis, plus vous rencontrerez de contenus publicitaires ou assimilés et incrémenterez donc le compte en banque du réseau social. Cette densité d’interaction globale de chaque individu est ce qu’ils appellent l’engagement.

En résumé, plus vous restez longtemps sur la plateforme, plus ils gagnent d’argent. Ce qu’on peut traduire par: plus la plateforme trouve des stratégies pour vous retenir et vous faire interagir, plus elle gagne d’argent.

Vous capturer plus longtemps n’est pas difficile quand on vous connait aussi bien. On sait quel genre de contenu vous attire et déclenche vos interactions, avec les membres de vos graphes sociaux. Cette capture de l’attention, du “moment de cerveau disponible”, comme disait le PDG d’une chaine de TV très suivie il y a quelques années, est réalisée avec le dernier cri des technologies de neuro-marketing. Facebook comme Google -les deux principales régies publicitaires- disposent de plusieurs laboratoires de recherche en neuro-sciences et en sciences de l’analyse des données1. Ces labos sont parfois mis en concurrence en interne pour favoriser l’innovation, et leurs découvertes permettent de tester constamment de nouvelles stratégies, de nouveaux services, pour augmenter l’engagement. Rien de plus faciles pour les plateformes: des milliards d’utilisateurs font office de rats de laboratoire. Les GAFAMS savent instantanément, en regardant le chiffre d’affaire en temps réel, si l’innovation est rentable ou non, et dans quelle population du monde.

Un régal pour la manipulation politique et sociétale

La possibilité d’intervention politique ou sociétale de masse est connue depuis l’émergence des réseaux sociaux. En utilisant les effets des algorithmes de sélection de contenu, un état ou une entreprise peut, avec une action coordonnée sur les flux et sur les données, manipuler la société au point de pouvoir influer radicalement sur une élection, sur un choix politique ou sociétal. Des milliards de faux comptes et de contenus dédiés sont créés chaque année par des “fermes à contenus” qui créent aussi des sites internet destinés à influer sur les moteurs de recherche et directement sur les internautes 4. Depuis Obama, premier mandat, dont les jeunes équipes de campagne innovent dans le domaine, c’est la ruée sur les applications politiques des réseaux sociaux.

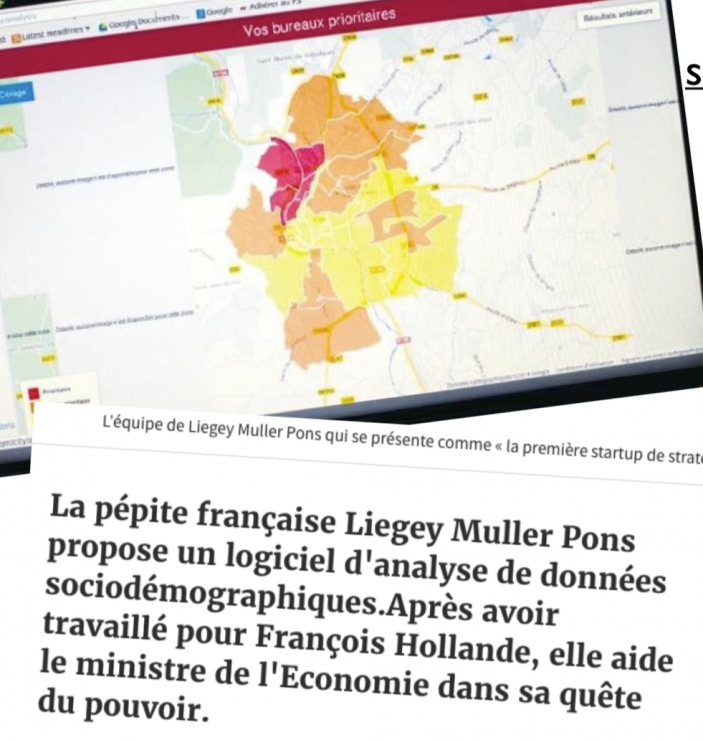

Des politiciens, des gouvernements, des religions ou mouvements sectaires, des agences et des entreprises comprennent qu’ils peuvent agir sur les foules en créant des contenus spécifiques pour des plateformes spécifiques. Grâce au ciblage et à la possibilité d’extraire des graphes sociaux, ils se servent de toutes les données disponibles pour détecter et cibler les indécis et les influenceurs sociétaux à toutes échelles, du simple concierge apprécié par son immeuble, au syndicaliste, en passant par un journaliste ou un artiste. Cela devient un métier. Des startups se montent par centaines, dont la renommée Cambridge Analytica, et proposent leurs services de manipulation politique des masses. Obama, Trump, Bolsonaro, Poutine, Macron, Modi et tant d’autres ont investi des sommes folles pour se faire élire, avec succès.

Dès les premières années d’existence des réseaux sociaux, de premières voix ont commencé à se faire entendre pour exiger un comportement (plus) éthique. Les plateformes-elles mêmes étudient les effets délétères avec une très grande attention, et tentent de les corriger, avec très peu de succès. Au début des années 2010, chez Facebook, des équipes spécialisées qui travaillent sur la problématique sont parfaitement conscientes du problème sociétal qui se pose: menace pour la démocratie, pour les liens sociaux, pour la paix civile. Mais la croissance de Facebook, bien que forte, ne donne pas encore de bénéfices. Après plusieurs essais de correction, infructueux, Mark Zuckerberg, appuyé par ses actionnaires, décide de ne quasiment rien changer au modèle économique basé sur l’engagement. Plusieurs dirigeants des réseaux sociaux, dégoutés, ont quitté leur plateforme à cette époque.

Plus le contenu est douteux, plus l’engagement est grand, plus le bénéfice est grand

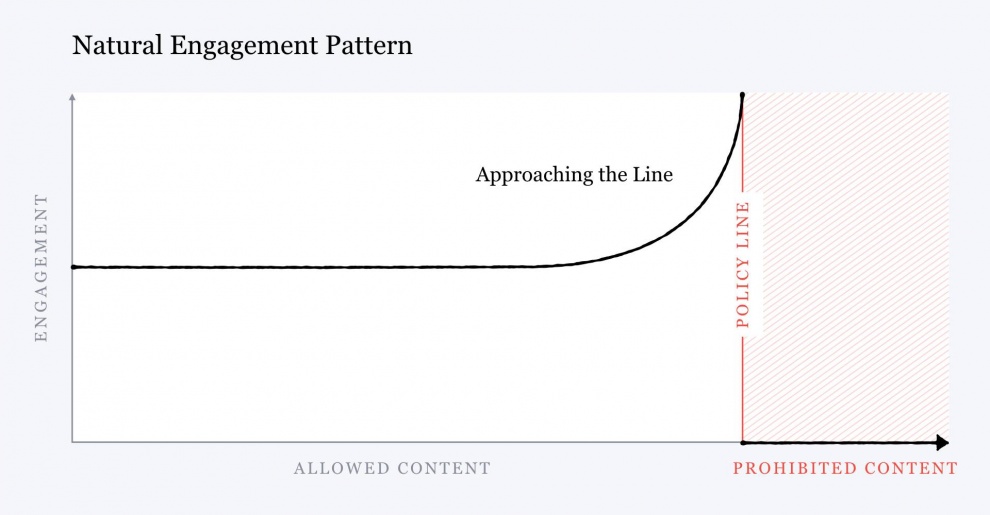

Chez Facebook, c’est vers 2008, un an après l’arrivée des premiers smartphones, qu’ils comprennent que les contenus contenant du buzz, du scandale, des fausses informations, des contenus sensationnalistes, radicaux, extrêmes, outranciers, violents, abusifs, complotistes ou pervers sont efficaces pour augmenter l’engagement. Sans modération, des contenus de ce genre peuvent se diffuser sur la planète entière en quelques heures.

C’est à cette période que Facebook décide d’étudier finement les relations entre contenus et engagement. Les résultats de ces études sont effrayants. Plus les contenus sont problématiques, plus la plateforme gagne de l’argent.

Certains contenus, notamment des violences, des appels à la haine, ou au meurtre, voire au génocide, font des ravages, créent des drames politiques, économiques, religieux ou sociétaux, qui concernent des dizaines ou centaines de millions d’individus. Sous la pression, à regret, Facebook établit rapidement des limites, des gardes-fou. Des filtres algorithmiques (automatiques) veillent, et signalent les cas contrevenant aux règles de modération, vers des modérateurs humains, qui peuvent censurer ou non. En 2021, sur FB, on peut toujours montrer ou relayer un appel au meurtre, sans être censuré par la modération 2, mais on ne peut toujours pas montrer un sein de femme, sauf dans quelques cas très précis. Les gouvernements, les associations, les organisations et l’opinion commencent à peine à réagir, mais leur pouvoir juridique se révèle très faible face à l’énorme pouvoir des plateformes.

La radicalisation par les bulles

Au fil des années, et jusqu’à aujourd’hui, en 2021, les contenus les plus radicaux, les plus douteux, les plus haineux, les plus faux, les plus polémiques, les plus débiles, sont toujours mis en avant si leur potentiel viral se révèle grand, ce que la plateforme sait, dès leurs premières rediffusions. La nécessité, pour l’algorithme, de trouver très rapidement des contenus augmentant l’engagement, provoque la sélection de contenus toujours plus offensifs, toujours plus radicaux, plus précis, plus catégorisés.3

Lorsqu’un utilisateur reçoit ces messages, et en manifeste un intérêt par des retransmissions à ses contacts, la plateforme lui servira des contenus similaires. L’accumulation de contenus thématiques de cette nature, renforcée par les effets d’approbation instantanée, les “Like”, les pouces levés, et autres reTweets, crée des bulles cognitives qui enferment des millions d’utilisateurs dans des opinions radicales.

La moindre polémique susceptible de garder l’attention d’un abonné met ainsi quelques dizaines de minutes pour se retrouver diffusée sur des centaines de milliers de comptes d’utilisateurs, quelques heures pour des millions de comptes. Techniquement, les passerelles entre les réseaux sociaux, notamment celles entre FB, Instagram, Twitter, Youtube ou Reddit amplifient encore plus l’enfermement thématique vers des opinions extrêmes.

On connait assez bien ces effets de bulle sur la radicalisation religieuse et le communautarisme religieux, dès le début des années 2010, et qui engendrent régulièrement des vagues terroristes lorsque ces religions se sentent attaquées et ” que les réseaux se mobilisent”, mais on a mis plus longtemps à comprendre les effets de cet enfermement sur l’évolution des idées. Les algorithmes de sélection de contenu ont des effets bien plus pervers sur les organisations consacrées aux problèmes sociétaux.

A l’inverse, un grand nombre de contenus ne sont pas montrés, étant trop difficiles ou trop lents à être compris: les débats étayés et référencés, les contenus historiques, les figures d’idéologie ou de philosophie pure, les contenus savants, intellectuels, “lents”, longs, sont considérés comme barbants par les algorithmes. Il n’y a plus de débat sociétal contradictoire, qui ne peut être réalisé que sur des temps longs. Seules les invectives passent. La diversité des visions disparait. L’historicité de tout débat disparait, et de nombreux jeunes sans culture n’ont plus de repères historiques sur les causes qu’ils veulent défendre.

La catégorisation des humains en groupes radicaux engendre la division de la société

En catégorisant les contenus à pousser vers les utilisateurs, les algorithmes ont catégorisé la société, la divisant en de multiples communautés virales, très visibles dans les médias, et incapables de débat entre-elles. En effet, l’invective étant toujours priorisée pour sa viralité, ce sont toujours les franges offensives et extrêmes d’un mouvement qui sont mises en avant. Au final, les algorithmes créent de nouvelles micro-idéologies très sectorisées, se penchant sur des détails au lieu de conserver des communs. Ces théories sociétales extrêmes se construisent de bric et de broc, sans base théorique ni intellectuelle, sans base historique, et finissent par se diffuser à plus grand nombre, par la viralité des polémiques ou des radicalités qu’elles génèrent.

Le débat devient impossible, non seulement pour cet effet d’accumulation et de mise en avant de paroles extrêmes au détriment des réflexions de temps lent, mais aussi à cause des interfaces d’interaction avec les plateformes qui favorisent la viralité instantanée, l’exclusion et l’invective. Un clic “réflexe” suffit à approuver ou rejeter l’autre. Les systèmes de catégorisation, comme les hashtags par exemple, construisent facilement des communauté de haine. Quant aux insultes, rien de plus facile de les faire visualiser par des millions de personnes. Cette rapidité transforme le harcèlement en jeu. Ce design de l’interaction construit en quelques clics une ostracisation de ceux qui n’adhèrent pas à ces radicalités.

La haine algorithmique

En moins de 10 ans, les mouvements historiques de la contestation -féminisme, anti-racisme, droits sociaux, droits des minorités, droits de l’humain, droits de l’environnement, etc.- se sont scindés en de multiples sous-idéologies radicales, oubliant leur histoire, incapables de s’entendre sur des communs essentiels. En concentrant l’énergie des activistes sur des causes anecdotiques ou factices, la division de ces causes donne le champ libre aux idéologies totalitaires. Ne parlons pas des conflits entre religions ou entre nations, territoires, populations, jamais ils n’ont été aussi exacerbés, et loin de résolutions pacifiques.

Politiquement, les conséquences sont importantes: les gauches mondiales ont du mal à s’unir devant des échéances électorales cruciales, dévastées par des querelles de chapelle de plus en plus violentes, et laissent le champ libre aux organisations extrémistes, dont la radicalité n’a jamais comporté de débat et dont les messages simplistes se diffusent intacts sur les réseaux. Même les milieux écologistes en sont affectés, avec des scissions importantes, tant du point de vue des idées que du point de vue des stratégies politiques. Ces divisions annihilent l’efficacité de tous les champs de la contestation, un régal pour l’économie capitaliste qui déteste des perturbations de son modèle.

Pire, des mouvements historiquement dédiés au progrès de l’humanité fleurissent en promouvant des actions dirigées contre leur propre camp, par exemple, des mouvements ou des personnalités anti-racistes promouvant des événements ou des actions basés sur la couleur de peau, c’est-à-dire clairement racistes ! Le mouvement Woke ou la Cancel Culture illustrent tous les jours cette schizophrénie. Les amalgames étant courants dans les contenus virulents, il se crée des mouvements hétéroclites qui mélangent complots, religion, fausses sciences, fausse information, violence, xénophobie ou racisme, comme QAnon. Ces contenus sont portés par une population relativement crédule, et apte à s’enflammer rapidement dans des mouvements réflexe. C’est exactement cette population que recherchent les publicitaires, et donc les algorithmes…

The medium is the message. Jamais cette maxime de Marshall McLuhan n’a été aussi bien illustrée par les réseaux sociaux. Un médium qui formate ses utilisateurs pour qu’ils visionnent le maximum de publicités en organisant leur enfermement dans des contenus ciblés. Un médium techniquement conçu comme système d’observation et de manipulation de ses abonnés au service de la consommation. Un médium qui évacue les débats, l’histoire et les communs. Un médium qui met en avant les extrêmes. Un médium qui génère des groupes intolérants et ignorants du passé. Un médium qui supprime la démocratie et favorise les totalitarismes.

Il ne faut cesser de rappeler que les réseaux sociaux sont des régies publicitaires fournissant des services, et dont le modèle économique est directement dépendant de la manipulation intentionnelle et nocive de milliards d’individus. Cette publicité est l’outil premier, le socle sur lequel vit le capitalisme. Nous avons pourtant tous les moyens de refuser ce monde publicitaire et d’utiliser des services éthiques. Il y a des alternatives éthiques à tous les types de réseaux sociaux. On ne peut pas prétendre servir des causes, comme l’écologie, qui combattent les effets du capitalisme, tout en utilisant leur principal outil de manipulation des masses.

Jean-Noël Montagné

Reférences:

1: https://www.technologyreview.com/2021/03/11/1020600/facebook-responsible-ai-misinformation/

3: https://www.nature.com/articles/s41599-020-00550-7

4:https://edition.cnn.com/2019/11/13/tech/facebook-fake-accounts/index.html

Pour aller plus loin:

Films et enquêtes:

Derrière nos écrans de fumée (2020)

Cash Investigation – Nos données personnelles valent de l’or (mai 2021)

Les incontournables vidéos de Science4All de Lê Nguyên HOANG

Associations et alternatives:

Comment dégoogliser Internet avec l’Association Framasoft

Des centaines de ressources éthiques (Engl.)

Diapos de mes conférences sur le sujet

et tant d’autres !

L’image de tête est un montage issu du clip dédié à ce sujet ” Are you lost in the world like me ?“